Aux côtés des désormais classiques radars, Lidars et autres caméras, une startup française développe un nouveau type de capteur qui pourrait radicalement améliorer les performances de la voiture autonome.

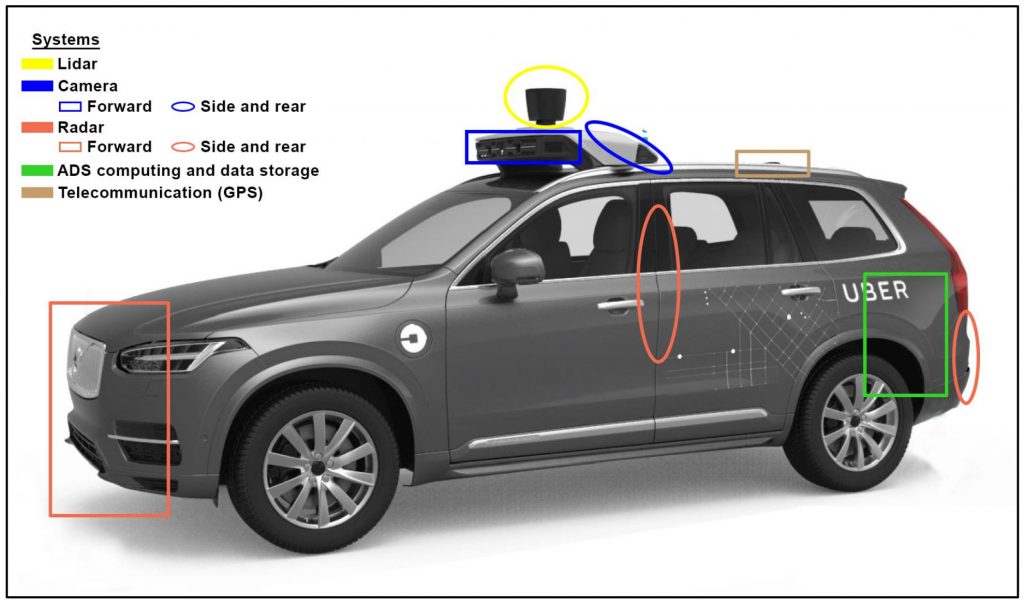

Le tragique accident du prototype de voiture autonome Uber, qui a coûté la vie à Elaine Herzberg en mars 2018, a rappelé de la plus violente des manières que le sujet de l’intelligence artificielle appliquée à l’automobile ne laissait aucune place à l’à peu près. Mais aussi que le plus délicat pour les calculateurs était d’identifier avec certitude les obstacles et autres usagers de la route. En effet, selon le rapport publié fin 2019 par le NTSB, l’autorité américaine de sécurité des transports, le système de conduite autonome développé par Uber qui équipait le Volvo XC90 impliqué dans l’accident a eu toutes les peines du monde à identifier et classer « l’objet » constitué par Elaine Herzberg poussant un vélo chargé de cabas. Tour à tour considéré comme un « véhicule », une « bicyclette » ou tout simplement rangé dans la catégorie « autres », il n’a été formellement identifié comme étant susceptible de se retrouver sur la trajectoire du SUV que 1,2 seconde avant l’impact. Autant dire bien trop tard pour réagir.

Aujourd’hui, les prototypes de véhicules autonomes disposent de trois types de capteurs : des radars laser (Lidars) qui analysent l’environnement à 360 degrés avec une portée d’une centaine de mètres, des radars au faisceau plus étroit mais potentiellement plus long (de 50 à 200 m de portée) et des caméras filmant dans le spectre de la lumière visible. Ces capteurs sont complémentaires : les Lidars dressent une cartographie globale de l’environnement, mais sont sensibles aux conditions météo ; les radars ont un champ plus étroit mais percent le brouillard ; quant aux caméras, elles fournissent à l’intelligence artificielle un moyen de détecter et d’identifier les objets. Mais cette dernière a encore beaucoup de boulot pour faire le tri entre vélos, triporteurs, piétons en trottinettes… L’une des pistes est donc d’améliorer encore les capteurs de manière à ce qu’ils fournissent davantage d’informations.

La première piste est d’adopter des caméras infrarouges. En effet, en ajoutant une vision thermique, on peut plus facilement repérer les objets chauds, comme… les corps humains. Si le Volvo XC90 de Uber avait eu une telle caméra, peut-être aurait-il pu s’arrêter à temps, et Elaine Herzberg serait-elle toujours de ce monde. Ou pas, car les sources de chaleur sont abondantes sur les routes et à proximité : bitume chauffé par le soleil, gaz d’échappement, freins, moteurs, bouches d’aération ou d’égouts… Et en cas de canicule, il devient plus difficile de distinguer un piéton à 37 degrés de son environnement.

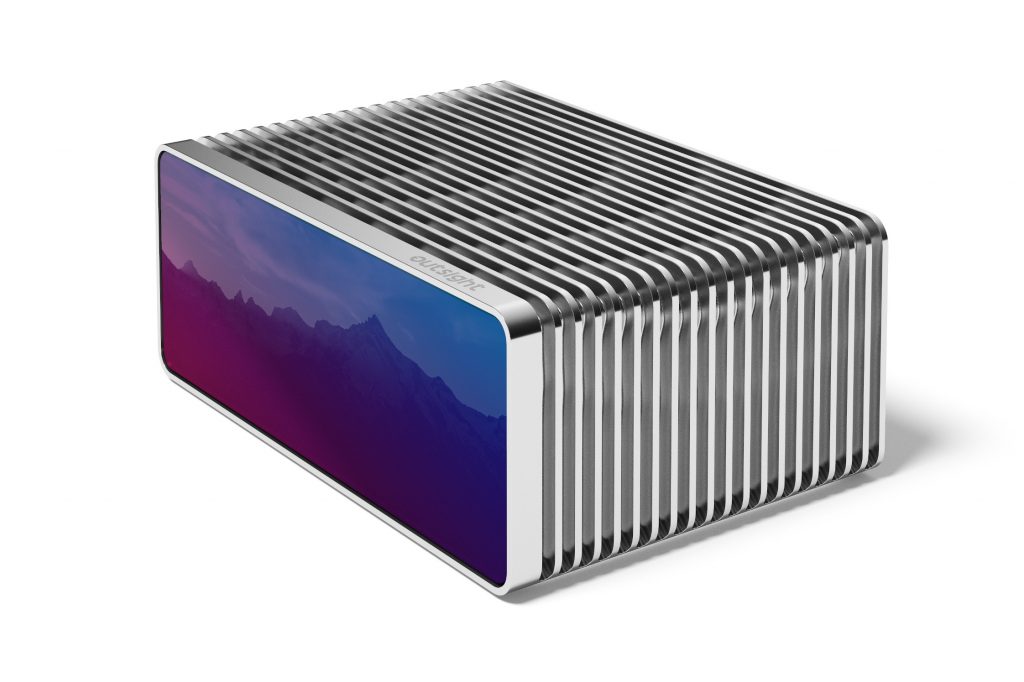

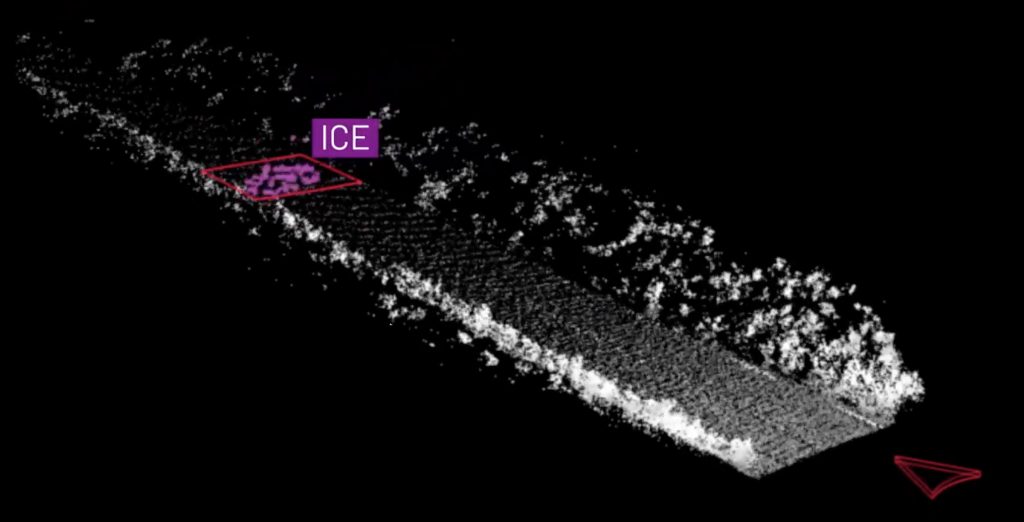

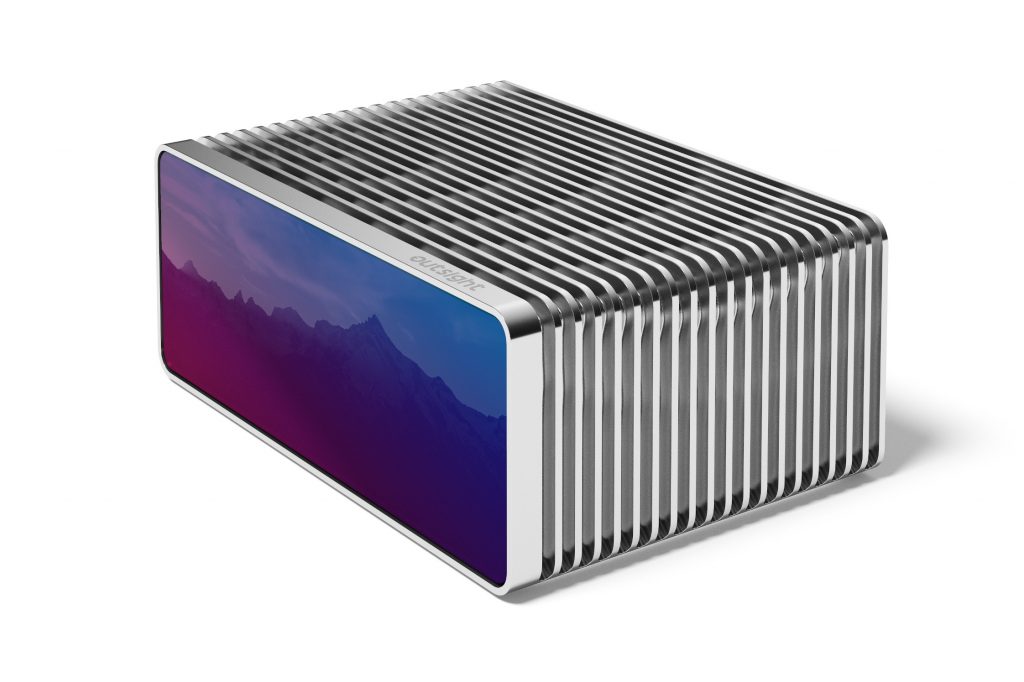

Mais une entreprise technologique française a peut-être trouvé la solution ultime, la caméra « œil de lynx » capable d’identifier facilement tous les obstacles ! L’entreprise, baptisée Outsight, a été cofondée par Raul Bravo, un ingénieur d’origine catalane, et Cédric Hutchings, l’homme derrière les objets connectés Withings. Ils qualifient le super-capteur qu’ils ont mis au point de « caméra 3D sémantique ». Son fonctionnement repose sur le principe de la spectrométrie. La caméra envoie un faisceau laser sur la cible, mais celle-ci n’en réfléchit qu’une partie, en fonction les matériaux qui la composent. En analysant le spectre du faisceau lumineux réfléchi, la caméra peut alors déterminer la composition de l’objet : textile, peau, bitume, acier, mais aussi glace ou huile. Et cette détection peut s’effectuer à plusieurs centaines de mètres. En outre, la caméra 3D sémantique d’Outsight dresse également un portrait tridimensionnel de la cible, à la manière d’un Lidar classique.

Évidemment, avec un outil de détection aussi performant, la tâche de l’intelligence artificielle pilotant le véhicule autonome est grandement facilité. D’autant qu’Outsight se refuse à avoir recours à des bases de données issues du « machine learning » (l’apprentissage des formes par vision successives de milliers d’images), et préfère se référer aux lois de la physique et de la mécanique afin de prédire les trajectoires d’objets. Mais la caméra d’Outsight pourra aussi équiper des véhicules non autonomes : elle signalera à leur conducteur la présence d’une plaque de verglas ou d’une nappe d’huile sur la route plusieurs centaines de mètres en amont.

Une telle innovation intéresse évidemment de près les investisseurs. L’équipementier automobile Faurecia et le géant de l’aéronautique Safran sont ainsi entrés au capital d’Outsight, qui vient par ailleurs de lever 20 millions de dollars auprès d’investisseurs. Une levée de fonds qui doit permettre de monter une ligne de fabrication pilote de caméras d’ici à 2021, tandis que des prototypes sont déjà en circulation en France. Reste maintenant à savoir quel sera le premier constructeur à adopter une caméra Outsight…

PS : J’ai découvert Outsight en écoutant l’excellent podcast Autonocast (en anglais). Si le sujet de la voiture autonome vous passionne, je vous le recommande chaudement !

Pour l’instant la conduite autonome ,reste un expérience ! Et l’inattention au volent de nombreux conducteur est bien là !!! ne devrions nous pas ,nous penchez plus sérieusement sur ce comportement

et prévoir des stages de prévention et de remise à niveau ? car toutes les autres inventions de nos chers politiciens plus fols les unes que les autres ! n’apporte et ne donne aucune solution

les radars 80 km heure les ralentisseur tous cela pour toujours encore pas mal de mort sur les routes

merci aussi au portable en voiture et autre modernités